Het (private) onderzoekslab OpenAI publiceerde kort geleden een van hun laatste resultaten: ze zijn er in geslaagd om relatief realistisch uitziende teksten te genereren van enkele paragrafen lang, gegeven een eerste zin. Ze namen tegelijk de opmerkelijke beslissing hun code en model niet openbaar te maken, omdat die dan te gemakkelijk en te snel te misbruiken zou zijn. Zowel experten als media hebben daar uitvoerig over bericht. Dat is immers ongebruikelijk: de AI-onderzoekswereld heeft een zodanig lange geschiedenis van hoogdravende claims die achteraf gebaseerd bleken op selectieve data, fouten in de code of wishful thinking, dat het openlijk publiceren van code en data omwille van de reproduceerbaarheid de norm is.

Met AI wordt al langer geprobeerd om realistische dingen te produceren die nauwelijks van de echte te onderscheiden zijn. Denk aan het genereren van de speelomgevingen in videospellen, of het maken van realistische uitziende landschappen in fantasy-films. Daarmee blijven we nog in een context waarvan iedereen weet dat ze virtueel is. Je mag je echter gerust ongemakkelijk beginnen voelen bij deze: iedere keer dat je naar thispersondoesnotexist.com surft, krijg je een volledig AI-gegenereerd fotorealistisch gezicht te zien. Het fenomeen van “deepfakes”, waarbij iemands hoofd in een video kan worden vervangen, is een uitloper in dezelfde zin.

Genereren van realistische teksten en foto’s: je beseft onmiddellijk dat dit een handige tool kan zijn voor scammers, die met betere valse profielen en berichten gemakkelijker iemand kunnen oplichten. Plots moet je al goed gaan opletten om er niet in te trappen. The Verge beëindigde hun artikel daarover onheilspellend: “dit is slechts de beleefde introductie tot wat ons nog te wachten staat…”. Een objectievere risico-analyse wordt gegeven in dit lijvige rapport van enkele universiteiten.

Maar laat ons vooral zelf eens in detail kijken naar zo’n stukje gegenereerde tekst van OpenAI:

Gimli was a tall and powerful man, and he had a beard and a moustache. He was also a dwarf, and he had a strong build, and he was covered in tattoos. He was not a man who looked like a hobbit.

Daaruit blijkt:

- De grammatica is nagenoeg perfect.

- De thematiek blijft behouden over de zinnen heen.

- De inhoud van de zinnen is echter niet altijd onderling consistent.

- Stilistisch is het wat slordig: veel in herhaling vallen.

Tekstgeneratoren bestaan al langer, van bijvoorbeeld academische papers of new-age bullshit . Waar de teksten die daar uit komen nog eerder samenraapsels zijn van jargon, vraagt de output van het OpenAI-model toch al een aandachtiger lezing om te beseffen dat er iets niet klopt. Er is ook al langer een merkelijke stijging in het aantal mensen dat zich laat vangen door oplichters die er in slagen steeds realistischer, soms sterk gepersonaliseerde, berichten te sturen. Ook complottheorieën en kwakzalverij vinden steeds meer weerklank. En hoewel hoaxes van alle tijden zijn, staat desinformatie met politieke doeleinden de laatste jaren in het middelpunt van de aandacht onder de noemer fake news.

Daarom is het nuttig om eens te reflecteren over wat dit kan betekenen in de nabije toekomst. Is normale kritische zin binnenkort nog wel voldoende om echt van vals te onderscheiden? En wat is daarbij rol van de grote gratis online platformen, die ons online leven beheersen?

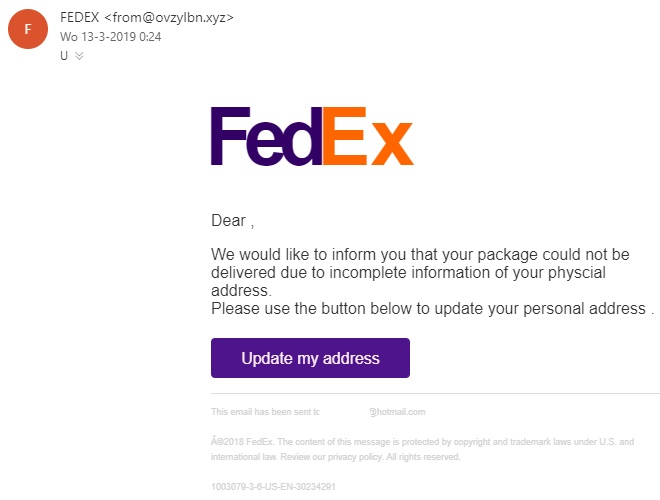

Spear phishing

Spear phishing is een gepersonaliseerde vorm van phishing waarbij de aanvaller een welbepaald doelwit viseert en zijn aanval personaliseert voor dat doelwit. Het heeft weinig zin om te proberen paswoorden te achterhalen via een Belfius-phishingmail als het doelwit klant is bij Axa. Traditioneel gebeurt spear phishing op kleine schaal en worden vooral mensen in belangrijke posities geviseerd (bvb CEO fraude). Het is immers nodig om zoveel mogelijk gegevens te verzamelen over het slachtoffer om de aanval te doen lukken, en dat was vooralsnog langdurig manueel werk.

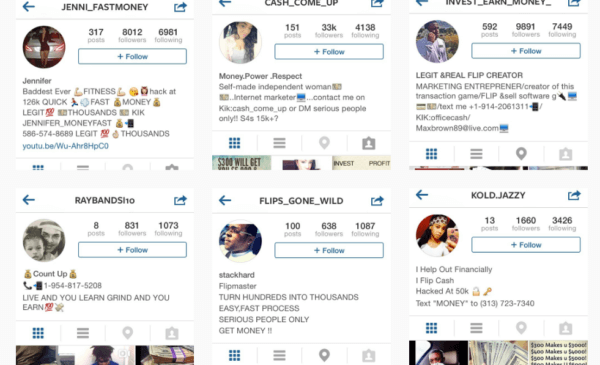

De grootschalige adoptie van sociale media maakt het mogelijk om zulke gepersonaliseerde aanvallen op grotere schaal uit te voeren. Iemands profiel en berichten van Twitter, Facebook, LinkedIn, Instagram, … downloaden en analyseren op thematiek, plaatsnamen, likes etc. kan allemaal volautomatisch. Exact dezelfde technologie wordt al lang gebruikt om je gepersonaliseerde advertenties voor te schotelen op allerlei websites. Een scammer hoeft hetzelfde concept maar toe te passen op phishing mails – wat de geloofwaardigheid dusdanig zou kunnen verhogen dat het soms al laser phishing wordt genoemd.

Een lichtpunt is wel dat spamfilters en scamdetectoren ook van AI gebruik kunnen maken om dit alles te gaan bestrijden. In die zin spelen we nog altijd een spelletje spammer vs. spamfilter waarbij beide partijen met gelijke wapens strijden. Enkel, met AI gebeurt dat vandaag wel allemaal op een hoger niveau.

Desinformatie

Bij discussies over desinformatie, al dan niet in relatie tot vrije meningsuiting, hanteert men best een strikte definitie en wijkt men daar niet van af. Voor het gemak adopteer ik die van het actieplan tegen desinformatie van de Europese Commissie: desinformatie is verifieerbaar foute info, met als doel om te misleiden of te profiteren, ten koste van de gemeenschap. Afwijkende of extreme meningen over politiek, wetenschap, ethiek of moraal vallen daar niet onder, evenmin als opiniestukken, satire, parodie, lobbying, campagnevoeren, het selectief presenteren van informatie, of religie.

Waar moeten we op voorbereid zijn als daar AI aan toegevoegd wordt? Niet noodzakelijk de automatische creatie van fake news zelf – voor de beste resultaten komt daar vooralsnog manueel werk bij kijken – maar eerder de verspreiding of het automatisch kunnen “hypen” van fake news eens dat gecreëerd is. Astroturfing, het opzetten van valse grassrootsbewegingen, waar vroeger nog mensen voor werden ingezet (clickfarms in lageloonlanden), kan nu goedkoper en gemakkelijker met een legertje bots.

Stel dat iemand tienduizend artikeltjes kan genereren over een bepaalde stelling, en die publiceert op duizenden blogs en (realistisch uitziende) socialemedia-accounts. Dan zijn er misschien maar enkele die coherent en realistisch genoeg lijken, maar dat is op zich genoeg om opgepikt en gedeeld te worden door andere gebruikers, eventueel de mainstream media te halen, en zo uiteindelijk een plaats te veroveren in de publieke opinie. Zo dreigt de verspreiding van moeizaam bekomen echte feiten bedolven te worden onder lawines van gefabriceerde berichtgeving waarvan de inhoud en de bron nauwelijks te verifiëren zijn.

In de strijd voor de aandacht van de consument en de burger is er bewijs dat zulke tactieken in opmars zijn. Naar aanleiding van de Russische desinformatiecampagnes met betrekking tot de Oekraïnecrisis of de crash van vlucht MH17 richtte de EU al in 2015 een observatorium voor desinformatie op. Het is geweten dat sommige verkiezingen of referenda op die manier beïnvloed worden, door binnenlandse en buitenlandse actoren.

Amplificatie door selectie en aanbeveling

Een versterkende factor is daarbij dat de selectie van de nieuwsberichten en persartikels die we zien, al jarenlang grotendeels aangestuurd wordt door AI. Net zoals de aanbevelingen op Youtube, Netflix en Spotify, zit er een recommender system achter vele nieuwswebsites, met als hoogste doel: je zo lang mogelijk op de website houden, zodat je zoveel mogelijk reclame-inkomsten opbrengt. Het bieden van een divers aanbod past niet bij die doelstelling: Spotify zal je geen klassieke muziek voorschotelen als je al een half uur naar rock aan het luisteren bent “voor een gezonde afwisseling”, integendeel, ze geven je meer van hetzelfde opdat je zeker zou blijven luisteren.

Zeker in het geval van Youtube is herhaaldelijk aangetoond hoe hun algoritme je binnen de kortste keren samenzweringsvideo’s serveert, en zo radicalisering of desinformatiecampagnes in de hand werkt en zelfs promoot. Iemand die er info opzoekt over de nationale bank, hoort sneller over illuminati dan over het bruto binnenlands product. Ook kinderen die op zoek zijn naar achtergrondinfo voor hun huiswerk, zijn daar niet tegen beschermd.

Herinner je dat het objectief van sociale media is om je op hun site te houden. Objectieve of nuttige inhoud helpen daarbij niet; opruiende, provocerende of sensationele inhoud des te meer. Die laatsten worden dan ook proportioneel meer weergegeven en eindigen uiteindelijk hoger in de zoekresultaten waardoor ze nog gemakkelijker aanbevolen worden: een zichzelf versterkend feedbacksysteem dat er voor zorgt dat uiteindelijk het extreme mainstream wordt. Een van de duidelijkste voorbeelden van deze dynamiek is misschien wel het huidige succes van de antivaccinatielobby.

Vorig jaar werd er nog gesteld dat fake news weliswaar wijdverspreid was, maar relatief weinig impact had. Met systemen die geloofwaardiger teksten en argumenten kunnen genereren voor foutieve stellingen, in combinatie met aanbevelingsalgoritmes die de extremen bevoordelen, zou die impact wel eens sterk kunnen vergroten. De grote platformen zetten slechts na grote publieke druk nu pas de eerste stapjes in het tegengaan van deze dynamiek.

Verweer tegen de zwarte kunsten

Voor techies en AI-bedrijven

Aan de technische kant groeit de aandacht voor governance, vrij vertaald als “goed beheer”, waarbij vaak het acronym FATE gehanteerd wordt, voor Fairness, Accountability, Transparency and Ethics. Doel is om ontwikkeling, uitrol en beheer van AI-systemen te toetsen op deze kwaliteiten. De laatste jaren worden specifieke conferenties ingericht over het onderwerp, wat goede fora zijn om over de laatste nieuwe voorstellen of best practices te leren. De grote spelers geven er alvast aandacht aan: o.a. IBM en Google werken aan tools om bvb. oneerlijke bias in datasets te detecteren. Die laatste heeft ook richtlijnen ontwikkeld rond AI governance. Voor alle AI-ontwikkelaars is dat ongetwijfeld een goede oefening om te herhalen.

Wat betreft accountability is Explainable AI een belangrijk onderwerp. Met name bij deep learning is het moeilijk om te achterhalen waarom een AI-system een bepaalde conclusie heeft bereikt: het aantal parameters en het trainingsproces is gewoon te groot om nog overzichtelijk te zijn. Nu AI steeds meer ingang vindt in het dagelijks leven en vragen rond rechtvaardigheid en aansprakelijkheid zich beginnen stellen, wordt de “waarom”-vraag plots belangrijk. Pasklare oplossingen zijn er echter nog niet en het veld en de beschikbare tools staan nog in hun kinderschoenen.

De strijd tegen desinformatie gebeurt momenteel vooral manueel, bvb. met fact-checking websites of het inhuren van moderatoren. De (gedeeltelijke) automatisering van dit proces is nog niet ver gevorderd: pogingen om fake news met AI te detecteren geven gemengde resultaten. Hier zijn dus nog opportuniteiten voor wie nog een nuttig AI-project zoekt, en ook meer analyses naar de reikwijdte en impact zijn zeker welkom.

Voor burger en consument

Profiling bestaat en is zelfs courant. Wie bij de bank om een lening vraagt zal sowieso allerlei gegevens moeten opgeven die de bank zal gebruiken om een risico-analyse te maken voordat ze een kredietvoorstel doet. Maar niets houdt de bank echter tegen om daarnaast ook eens stiekem te kijken naar de publieke inhoud van je sociale media. Wees je er van bewust dat alles wat je daarop zet kan gebruikt worden door vriend én vijand. Een dure hobby, vaak ziek, of problemen op het werk? Een bank zou het uit je sociale media kunnen afleiden en dat gebruiken om je een hogere rente aan te rekenen. (Dit is een fictief voorbeeld, ik weet ook niet of het legaal zou zijn, maar het is alleszins technisch wel mogelijk.)

(Sociale) media bepalen ook wat je te zien krijgt op basis van dat profiel, qua advertenties en/of inhoud. Wat jij ziet online is niet wat iemand anders ziet. De gepersonaliseerde aanbevelingen van webwinkels zoals Amazon zijn daarvan een goede illustratie. Op die manier zit iedereen op zulke platformen in zijn eigen filter bubble, maar dat wordt niet zo aan je voorgesteld. Hou in het achterhoofd dat jouw doel om juiste, relevante, objectieve informatie te vinden, fundamenteel verschilt van het doel van een internetplatform, namelijk winst maken.

Hoe bescherm je jezelf tegen valse informatie, scams of manipulatie? Ten eerste, bronnen checken en voorrang geven aan de kwalitatieve variant, gaande van goede journalistiek tot peer-reviewed wetenschap. Die zijn ook niet perfect, maar zijn gemiddeld genomen alleszins veel betrouwbaarder dan een willekeurige blogger of influencer op Twitter of Instagram. Ten tweede, het cultiveren van een attitude van Digitaal Skepticisme t.o.v. alles was je leest en ziet op het internet, zelfs als het afkomstig is van vrienden of familie. Paranoia is niet nodig, maar je wil waarschijnlijk wel vermijden om als “nuttige idioot” mee te werken aan verspreiding van foute informatie.

Voor beleidsmakers en overheid

Besef is ook voor politici en beleidsmakers belangrijk. Als mensen met beslissingsbevoegdheid zijn zij bij de eersten die geviseerd worden door actoren met slechte bedoelingen. Ook zij zijn vatbaar voor selectieve informatie, en kunnen te maken krijgen met gerichte manipulatie of grootschalige (geautomatiseerde) desinformatiecampagnes. De reikwijdte van sociale media is hen waarschijnlijk welbekend, maar de verschillende manieren waarop de informatieoorlog gevoerd kan worden misschien nog niet. In dat licht is het rapport van het Franse ministerie van defensie over het onderwerp verplichte lectuur.

Verschillende landen kwamen al met strategische plannen voor AI over de brug, ook in België zijn er initiatieven. De impact daarvan zal wel beperkt blijven als de aanbevelingen niet gepaard gaan met de nodige investeringen. We moeten daarbij breder denken dan investeringen in de technologie, en ook onderzoek naar de maatschappelijke impact financieren. Het steunen van kwalitatieve (onderzoeks)journalistiek, kennisopbouw over AI in de eigen regio, en het aanmoedigen en faciliteren van permanent leren horen daar ook bij.

Met de Europese verkiezingen in aantocht begint men ook op dat niveau wat nattigheid te voelen. Begin 2018 kwam een door de Europese Commissie samengestelde High Level Expert Group van AI-experts tot een reeks aanbevelingen, waaronder de nood aan transparantie bij online nieuws. Daaruit volgde de EU code of practice on disinformation, een document getekend door o.a. Google, Facebook, Twitter en Mozilla, waarin die allen beloven stappen te ondernemen om de verspreiding van desinformatie via hun platformen tegen te gaan. Dit is een duidelijke keuze om te trachten de industrie zichzelf te laten reguleren in plaats van van bovenaf maatregelen op te leggen. Mogelijk speelde de korte tijd die er nog rest tot de Europese verkiezingen een rol in de beslissing om dat zo aan te pakken. Dat werd dan snel gevolgd door een actieplan tegen desinformatie, die de adoptie van de code of practice moet opvolgen. De toekomst zal uitwijzen of dat telt als eerste stappen in de goede richting, of als “too little, too late”.

______________________

Dit is een ingezonden bijdrage van Joachim Ganseman, IT consultant bij Smals Research. Dit artikel werd geschreven in eigen naam en neemt geen standpunt in namens Smals.