Publications

-

De performance van LLM’s: Een vergelijkende analyse tussen Frans en Nederlands

Uit onze evaluatie van een RAG-chatbot blijkt er een prestatieverschil te bestaan tussen het Frans en het Nederlands, wat wijst op een aanhoudende uitdaging bij het gebruik van meertalige grote taalmodellen (LLM’s). Dit prestatieverschil kan deels worden verklaard door de beschikbaarheid van de middelen die worden gebruikt om deze modellen te trainen, maar er kunnen ook andere factoren meespelen.

-

Performance des LLM : Analyse comparative entre le français et le néerlandais

Notre évaluation d’un agent conversationnel RAG a révélé un écart de performance entre le français et le néerlandais, soulignant un défi persistant dans l’utilisation des grands modèles de langage (LLM) multilingues. Cette différence de performance s’explique en partie par la disponibilité des ressources utilisées pour entraîner ces modèles, mais d’autres facteurs peuvent également entrer en jeu.

-

AI Sheets – Analyse and enrich data

FR AI Sheets est un outil no-code développé par Hugging Face pour l’enrichissement et la transformation de données avec l’IA. Grace à des prompts et à une interface intuitive, il permet d’évaluer et d’affiner les sets de données, en s’intégrant à l’écosystème open-source. NL AI Sheets is een no-code tool ontwikkeld door Hugging Face voor

-

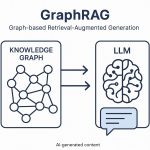

GraphRAG – Naar een verbeterde retrieval dankzij knowledge graphs

RAG-systemen (Retrieval-Augmented Generation) hebben het mogelijk gemaakt voor grote taalmodellen (LLM’s) om te steunen op betrouwbare gegevens. Maar ze blijven onder andere beperkt in hun vermogen om hallucinaties te beheersen. Daar komt GraphRAG in beeld: door LLM’s te combineren met knowledge graph verbetert het de nauwkeurigheid, transparantie en redeneercapaciteit van de modellen.

-

GraphRAG – Vers une génération augmentée par les graphes de connaissances

Les systèmes RAG (Retrieval-Augmented Generation) ont permis aux grands modèles de langage (LLM) de s’appuyer sur des données fiables. Mais ils restent limités, entre autres, dans leur capacité à contrôler les hallucinations. C’est là que GraphRAG entre en jeu : en combinant les LLM avec des graphes de connaissances, il améliore la précision, la transparence et la capacité de raisonnement des modèles.

-

Qualité des données dans le processus d’ingestion pour les grands modèles de langage : pratiques et défis

(FR) Dans le contexte des grands modèles de langage, la qualité des données joue un rôle crucial dans la performance des modèles et des applications basées sur ces modèles. Cette présentation explore les meilleures pratiques pour assurer la qualité des données tout au long du processus d’ingestion des données. Nous abordons les défis courants tels

-

EU AI Act: Beheersing van AI

AI literacy of AI-geletterdheid is een van de eerste verplichtingen van de AI Act die nu van kracht is.

-

EU AI Act : La maîtrise de l’IA

La maîtrise de l’IA ou l’AI literacy en anglais est l’une des premières obligations de l’AI Act à être entrée en vigueur.

-

Data ingestion voor generatieve AI-toepassingen: kernbegrippen

“Garbage in, garbage out” is een veelgebruikte uitspraak om de impact van data op de resultaten van kunstmatige intelligentiesystemen te beschrijven. Generatieve AI-toepassingen zoals vraag-en-antwoordsystemen vormen geen uitzondering op de regel. De knowledge bases waarop ze vertrouwen om antwoorden te genereren, moeten worden gevoed door een ingestion pipeline die speciaal is toegespitst op dit soort data, die in verschillende vormen…

-

Ingestion de données pour les applications d’IA générative: concepts-clés

« Garbage in, garbage out » c’est la formule consacrée pour décrire l’impact des données sur les résultats des systèmes d’intelligence artificielle. Les applications d’IA génératives telles que les systèmes de questions-réponses ne dérogent pas à la règle. Les bases de connaissances sur lesquelles elles s’appuient pour générer des réponses doivent être alimentées par un pipeline d’ingestion dédié à ce…

Keywords:

analytics Artificial intelligence big data blockchain BPM chatbot cloud computing cost cutting cryptography data center data quality EDA egov Event GIS governance Information management Machine Learning Managing IT costs methodology Mobile Natural Language Processing Open Source Privacy Productivity Security social software design software engineering standards