Interests: Data quality, Database et data management, Documents and Records Management, Metadata (thesaurus, …)

Publications

-

Open data et eGovernment : au delà des idées reçues, quelques bonnes pratiques

Né aux États-Unis, le mouvement open data est officialisé depuis la loi « Freedom of Information Act » de 1966. Son ampleur s’est accrue à la fin des années 1990 avec l’émergence d’Internet. L’encyclopédie libre Wikipedia fondée en 2001 constitue un exemple bien connu d’information ouverte au grand public et alimentée par celui-ci. Son contenu, dont la

-

Email Address Reliability

Avec la dématérialisation de l’information et la mise en place croissante de synergies entre administrations, employeurs, entreprises et citoyens, la qualité des adresses e-mail devient stratégique. En effet, une bonne gestion de celles-ci peut, dans le cadre de l’egovernment, contribuer à l’amélioration des services rendus et à la réduction des coûts. C’est le cas par

-

Rencontre « Data quality » FNRS-ULB-Smals le 30/01/2014 à l’Université Libre de Bruxelles

La prochaine réunion du groupe de contact FNRS « Analyse critique et amélioration de la qualité de l’information numérique » se tiendra le jeudi 30 janvier 2014 à 14h00 à l’Université Libre de Bruxelles (salle Solvay, bâtiment NO, 5ème étage, campus de la Plaine). L’accès à la rencontre, qui est financée par le Fonds National

-

Email Address Reliability

Avec la numérisation de l’information et la mise en place croissante de synergies entre administrations, employeurs, entreprises et citoyens, la qualité des adresses e-mail devient stratégique. En effet, une bonne gestion de celles-ci peut, dans le cadre de l’egovernment, contribuer à l’amélioration des services rendus et à la réduction des coûts. C’est le cas lorsque

-

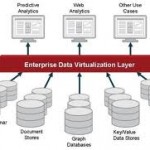

“Data Virtualization” : perspectives et points d’attention

L’approche “Data Virtualization” émerge depuis quelques années dans la littérature et sur le marché IT (voir par exemple : R. F. Van der Lans, “Data Virtualization for BI Systems. Revolutionizing Data Integration for Datawarehouse“, Morgan Kaufmann, Elsevier, 2012). A l’heure du “Big Data“, cette approche propose de séparer couches physiques, logiques et conceptuelles, pour faciliter l’accès aux

-

De la production industrielle à la production d’information : analogies, paradoxes et enseignements opérationnels

Les normes internationales actuelles en matière de “data quality” puisent leur origine au début du XXème siècle, dans la foulée de la révolution industrielle et du taylorisme, alors que la production et le montage en grande série réclament l’interchangeabilité des pièces. Aussi a-t-on recours au travail “à tolérances”, dans le cadre duquel les dimensions des pièces usinées peuvent

-

“Mapping the World of Data Problems” : la qualité des données vue par la communauté IT

En novembre 2012, O’Reilly Media a édité un “livre-événement” en matière de “data quality” : Q. E. McCallum, Bad Data Handbook, Mapping the World of Data Problems, O’Reilly Media, 2012, 246 p. Cet ouvrage collectif sur la qualité des données est inédit car il émane exclusivement de la communauté des web software developpers (Python, Perl script, Parallel

-

Data tracking – le “Return On Investment” de l’analyse des flux d’information

L’egovernment repose sur la gestion de vastes bases de données dont les enjeux sont stratégiques sur les plans sociaux, financiers et juridiques. Ces bases de données sont alimentées par des flux d’information (entre citoyens, entreprises, employeurs et administrations) véhiculant un grand nombre d’anomalies formelles (valeurs déviantes par rapport aux valeurs attendues) dont la gestion est

-

Améliorer la qualité de l’information : du “stemma codicum” au “data tracking”

Au Moyen-âge, le processus de transformation de l’information, avant l’invention de l’imprimerie, se déployait de siècles en siècles avec les générations de moines copistes. Afin d’établir l’appareil critique d’un manuscrit (dont on dispose souvent de multiples copies divergentes et dont on a parfois perdu l’original), l’historien construit un stemma codicum (généalogie des données), technique d’analyse

-

L’intéropérabilité sémantique : une révolution ? Les normes SKOS (W3C, 2009) et ISO 25964-1

Les standards en matière d’interopérabilité sémantique sont apparus en vue de répondre à la prolifération anarchique de langages hétérogènes, a priori incompatibles entre eux. Quand les applications concernées sont stratégiques et constituent des instruments d’action sur le réel, telles que dans l’egovernment, les enjeux en termes de coûts-bénéfices de cette problématique sont considérables. Dans la foulée de SKOS

Keywords:

analytics Artificial intelligence big data blockchain BPM chatbot cloud computing cost cutting cryptography data center data quality EDA egov Event GIS governance Information management Machine Learning Managing IT costs methodology Mobile Natural Language Processing Open Source Privacy Productivity Security social software design software engineering standards