data quality

-

Vérifier une adresse e-mail : un problème facile ? Partie II

Nous avons vu dans l’article précédent comment vérifier qu’une adresse électronique était susceptible d’exister, en en vérifiant la syntaxe, ou, autrement dit, qu’elle était grammaticalement correcte. Nous y avons montré que, pour faire les choses le plus précisément possible, et donc éliminer d’entrée de jeu un maximum d’adresses erronées, la problématique était bien plus complexe qu’imaginée

-

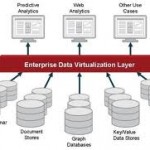

“Data Virtualization” : perspectives et points d’attention

L’approche “Data Virtualization” émerge depuis quelques années dans la littérature et sur le marché IT (voir par exemple : R. F. Van der Lans, “Data Virtualization for BI Systems. Revolutionizing Data Integration for Datawarehouse“, Morgan Kaufmann, Elsevier, 2012). A l’heure du “Big Data“, cette approche propose de séparer couches physiques, logiques et conceptuelles, pour faciliter l’accès aux

-

De la production industrielle à la production d’information : analogies, paradoxes et enseignements opérationnels

Les normes internationales actuelles en matière de “data quality” puisent leur origine au début du XXème siècle, dans la foulée de la révolution industrielle et du taylorisme, alors que la production et le montage en grande série réclament l’interchangeabilité des pièces. Aussi a-t-on recours au travail “à tolérances”, dans le cadre duquel les dimensions des pièces usinées peuvent

-

Vérifier une adresse e-mail : un problème facile ?

Gérer un carnet d’adresse électronique personnel peut sembler un problème assez facile. Finalement, on a surtout besoin d’avoir une adresse correcte pour ceux à qui on écrit fréquemment, et pour ces contacts-là, on prend vite conscience de l’obsolescence d’une adresse « e-mail » (ou courriel, pour emprunter un joli terme à nos amis Québécois). Mais lorsqu’il s’agit de

-

“Mapping the World of Data Problems” : la qualité des données vue par la communauté IT

En novembre 2012, O’Reilly Media a édité un “livre-événement” en matière de “data quality” : Q. E. McCallum, Bad Data Handbook, Mapping the World of Data Problems, O’Reilly Media, 2012, 246 p. Cet ouvrage collectif sur la qualité des données est inédit car il émane exclusivement de la communauté des web software developpers (Python, Perl script, Parallel

-

Data tracking – le “Return On Investment” de l’analyse des flux d’information

L’egovernment repose sur la gestion de vastes bases de données dont les enjeux sont stratégiques sur les plans sociaux, financiers et juridiques. Ces bases de données sont alimentées par des flux d’information (entre citoyens, entreprises, employeurs et administrations) véhiculant un grand nombre d’anomalies formelles (valeurs déviantes par rapport aux valeurs attendues) dont la gestion est

-

Améliorer la qualité de l’information : du “stemma codicum” au “data tracking”

Au Moyen-âge, le processus de transformation de l’information, avant l’invention de l’imprimerie, se déployait de siècles en siècles avec les générations de moines copistes. Afin d’établir l’appareil critique d’un manuscrit (dont on dispose souvent de multiples copies divergentes et dont on a parfois perdu l’original), l’historien construit un stemma codicum (généalogie des données), technique d’analyse

-

Gestion intégrée des anomalies – Évaluer et améliorer la qualité des données

Comme le confirment les consultances de terrain, ou encore les résultats des travaux scientifiques ou « marketing », comme ceux de Gartner en 2010, la qualité des données revêt toujours des enjeux stratégiques pour l’egovernment. Par exemple, en Belgique, la DmfA (Déclaration Multifonctionnelle – Multifunctionele Aangifte) permet le prélèvement annuel d’environ 40 milliards d’euros de

-

Gestion intégrée des anomalies – Evaluer et améliorer la qualité des données

Comme le confirment les consultances de terrain, ou encore les résultats des travaux scientifiques ou « marketing », comme ceux de Gartner en 2010, la qualité des données revêt toujours des enjeux stratégiques pour l’egovernment. Par exemple, en Belgique, la DmfA (Déclaration Multifonctionnelle – Multifunctionele Aangifte) permet le prélèvement annuel d’environ 40 milliards d’euros de

-

Talend neemt Sopera over: open source datamanagement + applicatie-integratie

De overname van Sopera (open source SOA en middleware) door Talend (open source data integratie en data management) creëert een heel sterke pure play open source middleware vendor, die kan profiteren van de synergie tussen data management en applicatie-integratie. Dit is m.i. goed gezien, want vaak zijn de redenen voor het falen van SOA-projecten e.d.

Keywords:

analytics Artificial intelligence big data blockchain BPM chatbot cloud computing cost cutting cryptography data center data quality EDA egov Event GIS governance Information management Machine Learning Managing IT costs methodology Mobile Natural Language Processing Open Source Privacy Productivity Security social software design software engineering standards