Information management

-

Working Predictive Analytics (4): Driven by Results

Het mooie aan Predictive Analytics is dat de techniek zich zo natuurlijk leent tot een resultaatgedreven aanpak. En dat willen we allemaal, toch? We willen nu weten welk resultaat we straks mogen verwachten. En als voor straks een ongewenst resultaat verwacht wordt, we willen nu weten wat we eraan kunnen doen. Ook al beseffen we

-

Case management : “oude software in een nieuwe verpakking?”

In de vorige blog over case management werden de belangrijkste functies van een case management systeem besproken. Zoals toen beschreven zijn deze functies: procesbeheer, documentbeheer, beheer metadata, agenda en taakbeheer, communicatiebeheer. Afhankelijk van de specifieke situatie zal de ene functie zwaarder doorwegen dan de andere. Dit heeft tot gevolg dat verschillende softwaretypes gebruikt kunnen worden

-

Dix bonnes pratiques pour améliorer et maintenir la qualité des données

(dernière mise à jour : décembre 2021) Les bases de données se prêtent aux métaphores financières. Ne les désigne-t-on pas souvent par le terme « banques de données » ? Elles évoqueraient ainsi un capital d’information sur lequel on peut faire des retraits à la demande. A condition que le compte soit correctement approvisionné…(*) Vu l’actualité des enjeux soulevés, dès

-

Case management : “een beetje van alles?”

De term case management wordt de laatste jaren steeds meer gebruikt door softwareleveranciers. Case management betekent niets meer dan dossierbeheer. Een automatisering van het beheer van dossiers is op zich natuurlijk niet nieuw. Jaren geleden al begonnen de eerste projecten om dossierbeheer te ondersteunen met ICT-middelen. Vaak waren deze projecten hoofdzakelijk maatwerk waarbij een systeem

-

Working Predictive Analytics (3): Feedback

Learning by doing. Feedback is cruciaal. Nadat we vorig jaar in de infosessie “Streamlining Analytics” enkele praktische aspecten in detail konden belichten (in a nutshell: overwinnen van barrières bij de introductie van Analytics in de organisatie – architectuur, data quality, methodologie – cfr. slideshare, research note), is het hoog tijd om een andere belangrijke succesfactor

-

Open data et eGovernment : au delà des idées reçues, quelques bonnes pratiques

Né aux États-Unis, le mouvement open data est officialisé depuis la loi « Freedom of Information Act » de 1966. Son ampleur s’est accrue à la fin des années 1990 avec l’émergence d’Internet. L’encyclopédie libre Wikipedia fondée en 2001 constitue un exemple bien connu d’information ouverte au grand public et alimentée par celui-ci. Son contenu, dont la

-

Rencontre « Data quality » FNRS-ULB-Smals le 30/01/2014 à l’Université Libre de Bruxelles

La prochaine réunion du groupe de contact FNRS « Analyse critique et amélioration de la qualité de l’information numérique » se tiendra le jeudi 30 janvier 2014 à 14h00 à l’Université Libre de Bruxelles (salle Solvay, bâtiment NO, 5ème étage, campus de la Plaine). L’accès à la rencontre, qui est financée par le Fonds National

-

Gestion des documents d’activité : enjeux documentaires et fonctionnels

La mise en place d’une politique de gestion des documents au sein d’un organisme nécessite tout d’abord d’identifier les documents qui sont engageants pour l’organisme, documents que l’on qualifiera de documents d’activité conformément à la nouvelle norme en la matière (ISO 30300). La mise en place d’un système de gestion de ces documents (record management

-

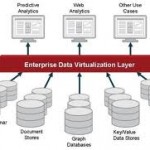

“Data Virtualization” : perspectives et points d’attention

L’approche “Data Virtualization” émerge depuis quelques années dans la littérature et sur le marché IT (voir par exemple : R. F. Van der Lans, “Data Virtualization for BI Systems. Revolutionizing Data Integration for Datawarehouse“, Morgan Kaufmann, Elsevier, 2012). A l’heure du “Big Data“, cette approche propose de séparer couches physiques, logiques et conceptuelles, pour faciliter l’accès aux

-

De la production industrielle à la production d’information : analogies, paradoxes et enseignements opérationnels

Les normes internationales actuelles en matière de “data quality” puisent leur origine au début du XXème siècle, dans la foulée de la révolution industrielle et du taylorisme, alors que la production et le montage en grande série réclament l’interchangeabilité des pièces. Aussi a-t-on recours au travail “à tolérances”, dans le cadre duquel les dimensions des pièces usinées peuvent

Keywords:

analytics Artificial intelligence big data blockchain BPM chatbot cloud computing cost cutting cryptography data center data quality development EDA egov Event GIS Information management Machine Learning Managing IT costs methodology Mobile Natural Language Processing Open Source Privacy Productivity Security social software design software engineering standards